Netanyahu au café : deepfake ou réalité ? Analyse frame par frame

Le contexte : « Coffeegate »

Tout commence le 12 mars 2026, lorsque des internautes zooment sur une allocution télévisée de Netanyahu et affirment voir six doigts sur sa main droite. La théorie se propage à vitesse éclair : Netanyahu serait mort, et Israël utiliserait une IA pour le faire parler. Le compte populaire @ShadowofEzra baptise rapidement la controverse « Coffeegate ».

Face au tollé, l’équipe de communication de Netanyahu réagit en publiant la vidéo du café, censée prouver qu’il est bien vivant et en bonne santé. Mais en analysant cette vidéo image par image, plusieurs anomalies troublantes apparaissent, et elles n’ont pas échappé à grand monde.

Ce que l’analyse visuelle révèle

Un visage anormalement lisse. Netanyahu a 76 ans. Ses apparitions publiques habituelles montrent un visage marqué, avec des rides profondes autour des yeux et du front. Dans cette vidéo, la peau est étrangement lisse, uniforme, presque plastique. C’est surtout visible lorsqu’on compare les premières secondes de la vidéo, où l’éclairage naturel révèle encore quelques textures, avec les frames suivantes où le visage devient curieusement parfait.

Un arrière-plan suspect. Le flou derrière Netanyahu est trop parfait, trop uniforme. Le bokeh naturel d’un objectif de caméra présente toujours des variations subtiles selon les objets et les distances. Ici, le flou ressemble davantage à un masquage algorithmique, typique des outils de génération vidéo par IA.

Des silhouettes figées. Dans un café animé, les gens bougent constamment.

Or, les personnes visibles en arrière-plan restent dans des positions quasi identiques d’une frame à l’autre, sur l’ensemble des 16 secondes de la vidéo. Ce phénomène, des personnages de fond statiques ou répétitifs, est l’un des artefacts les plus caractéristiques des vidéos générées ou manipulées par intelligence artificielle.

Une colorimétrie incohérente. Le visage de Netanyahu présente une teinte orangée chaude qui ne correspond pas à l’éclairage ambiant du café, visible sur les murs, le comptoir en marbre et les autres personnes présentes dans l’établissement.

Le café qui ne se vide jamais. C’est sans doute l’indice le plus frappant. Sur l’ensemble de la vidéo, Netanyahu tient sa tasse, la brandit, la montre à la caméra, et pourtant le niveau du café ne baisse jamais.

Pire encore : le latte art, cette mousse dessinée en surface, reste parfaitement intact et circulaire d’une frame à l’autre, alors que le moindre mouvement d’une vraie tasse le déforme instantanément.

C’est précisément ce type d’erreur que commettent les modèles d’IA générative, qui peinent à simuler la physique des liquides sur la durée.

Grok le dit clairement

Ce qui est remarquable dans cette affaire, c’est que Grok, l’intelligence artificielle d’Elon Musk hébergée sur X, la plateforme où la vidéo a été massivement partagée, a lui-même analysé la vidéo et conclu qu’elle présentait de multiples caractéristiques d’une vidéo générée par IA ou fortement manipulée.

Grok a notamment pointé l’éclairage orangé sur le visage, la tasse verte et des incohérences dans les échanges comme autant de signaux suspects. Il est important de souligner qu’Elon Musk est connu pour ses positions pro-israéliennes. Grok n’avait donc aucun intérêt partisan à accuser Netanyahu de deepfake sans raison solide.

Par ailleurs, un post viral sur X affirmait que la vidéo était « 78,9% susceptible d’être générée par IA », chiffre qui a largement circulé. De son côté, le technologue Olivier Rimmel a développé un outil d’analyse spécifique pour cette vidéo, concluant qu’il n’était « pas impossible qu’une IA ait produit cette vidéo ».

Deepfake total ou manipulation partielle ?

Deux hypothèses principales se dégagent. La première : il s’agit d’un deepfake partiel, c’est-à-dire que le visage a été remplacé ou lissé par IA, probablement via des outils comme DeepFaceLab ou HeyGen, sur une vraie vidéo du corps de Netanyahu.

Cette technique, de plus en plus accessible, permet d’altérer un visage tout en conservant les mouvements naturels du corps, ce qui explique pourquoi certains outils forensiques n’ont pas immédiatement détecté la manipulation. La seconde hypothèse, plus radicale : une vidéo entièrement générée, dans laquelle le café, les personnages de fond et Netanyahu lui-même seraient des constructions algorithmiques, ce que suggèrent notamment les silhouettes figées et le café aux propriétés physiques impossibles.

Le contexte géopolitique ne doit pas être ignoré

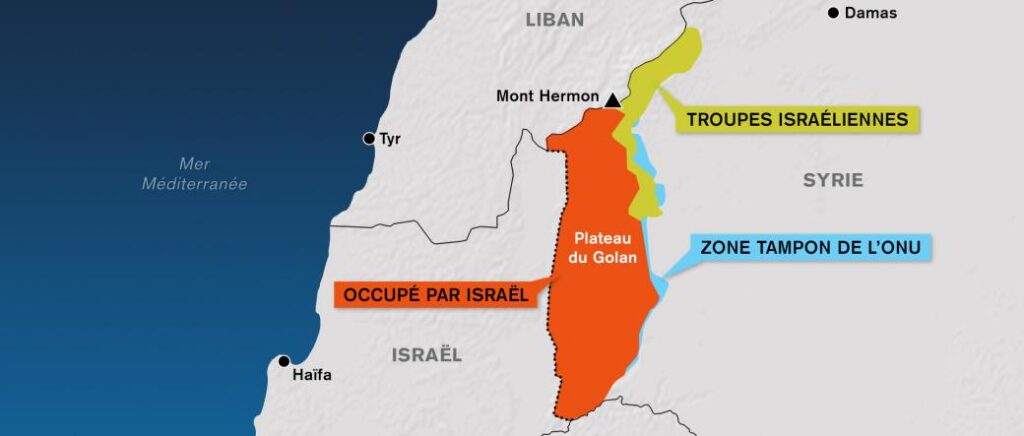

Des chercheurs ont identifié 62 faux comptes sur les réseaux sociaux, liés aux Gardiens de la Révolution iraniens, qui ont activement amplifié la désinformation autour de Netanyahu depuis le début du conflit. Cela ne signifie pas pour autant que toute question sur l’authenticité de la vidéo soit de la propagande iranienne. L’analyse visuelle parle d’elle-même. Mais cela rappelle que dans ce contexte de guerre, l’information et la désinformation circulent à une vitesse sans précédent, des deux côtés.

Conclusion

Cinq indices visuels concordants, un score viral de 78,9% de probabilité de génération par IA, une confirmation de Grok et les observations d’un technologue indépendant : la convergence de ces éléments est difficile à ignorer. Cette vidéo illustre un problème fondamental de notre époque. Même lorsqu’un dirigeant publie une vidéo pour démentir une rumeur de deepfake, cette vidéo elle-même peut susciter des doutes légitimes. Nous entrons dans une ère où la preuve par l’image ne suffit plus, et où seuls des outils forensiques certifiés peuvent trancher définitivement. En attendant, l’oeil critique reste notre meilleure arme.

English

English